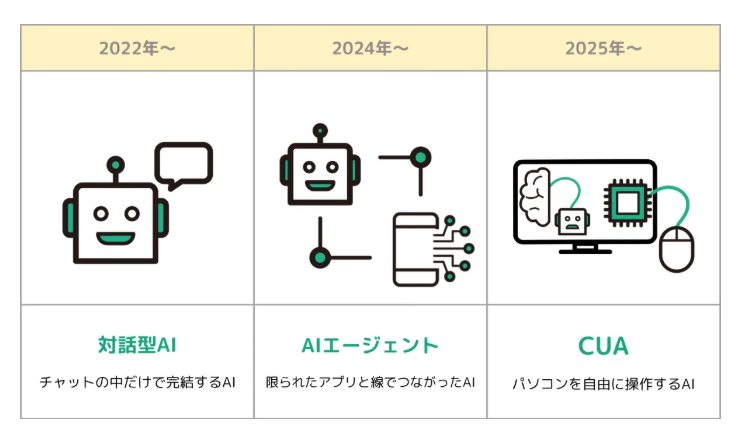

カラクリ(東京都中央区、小田志門代表取締役CEO)は、自然言語による指示でPCの自動操作が可能なCUA(Computer-Using Agent)向けのモデル『KARAKURI VL』を開発した。

KARAKURI VLは、日本のカスタマーサポート現場が直面する課題の解決を目的に、中国Alibabaの視覚言語モデル『Qwen2.5-VL』をベースとして、日本語環境に最適化して開発した。

既存のCUAモデルは海外企業によって、英語環境を前提として開発されており、日本語環境においては、文字認識精度や指示理解・実行精度に加え、ベンチマークの不在やビジネスアプリケーションへの対応不足などの課題があった。同社によると、日本企業が独自開発した例は初という。

技術的特徴は、日本語特有の縦書き・横書きが混在するUI(ユーザーインタフェース)の文字認識や読解能力、図表の理解に加え、オペレータの業務フローを自動で遂行できるよう設計されていること。具体的には、顧客からの問い合わせに対応しながら、複数システムの操作やマニュアルを参照して適切な回答を作成できる。

下記URLにて、対話型モデルと推論モデルの2つを公開している。

対話型モデル

https://huggingface.co/karakuri-ai/karakuri-vl-32b-instruct-2507

推論モデル

https://huggingface.co/karakuri-ai/karakuri-vl-32b-thinking-2507-exp

デモ環境

https://vl.karakuri.cc/

また、開発にあたって、国際標準ベンチマークOSWorldの日本語版を独自に作成。約400のタスクを日本の業務環境に合わせて改変し、日本語環境でのCUA評価の新たな基準として確立した。なお、2025年5月に人工知能学会が主催する「JSAI2025」にて発表、オープンソース化している。

今後は、コンピュータの操作権限を与えることによる暴走リスク、プロンプト作成に専門知識が必要な点、各社独自ツールへの対応といった実用面での課題の解決に取り組む。

2025年07月10日 14時00分 公開

2025年07月10日 14時00分 更新

コールセンタージャパン 2026年6月号(5月20日発売)

特集設計次第で人を超える?!「AIオペレータ」普及元年第2特集事例に学…

スキマ時間で声を変える! 毎日できるボイストレーニング

2026年6月号 <スキマ時間で声を変える! 毎日できるボイストレーニ…

秋竹朋子

元ファーストクラスCAの接客術“おもてなし力”の磨き方

2026年6月号 <元ファーストクラスCAの接客術 “おもてなし力”の…

江上 いずみ

AfterCall~電話の後で

2026年6月号 <AfterCall〜電話の後で>

山田祐嗣

市界良好

2026年6月号 <市界良好>

秋山紀郎

千客万来 百鬼夜行

2026年6月号 <千客万来 百鬼夜行>

多和田 元